Este nuevo poder “para hacerlos bailar” no emplea soldados para amenazar mediante el terror y el asesinato. Llega con un capuchino, no con una pistola. Es un nuevo poder “instrumental”, que trabaja su voluntad a través de instrumentos digitales omnipresentes, que permiten manipular señales subliminales, dirigir las comunicaciones psicológicamente, imponer arquitecturas de elección por defecto, desencadenar dinámicas de comparación social y proveer recompensas y castigos: todo dirigido a la sintonización remota, pastoreando y modificando el comportamiento humano hacia resultados rentables. Todo siempre diseñado para preservar la ignorancia de los usuarios. […] En 2016 Pokémon Go, el juego de realidad aumentada desarrollado por Google, probó las economías de acción en las calles. Los jugadores del juego no se sabían peones en el juego real de modificación del comportamiento con fines de lucro, ya que las recompensas y castigos por cazar criaturas imaginarias eran usados para llevar a los usuarios a McDonald’s, Starbucks y locales de pizza, que pagaban a la compañía por cada visita (pago por “pisada”), exactamente de la misma manera que los anunciantes online pagan por cada click en sus sitios web.

por Shoshana Zuboff (traducción de Andrés Fielbaum S.)

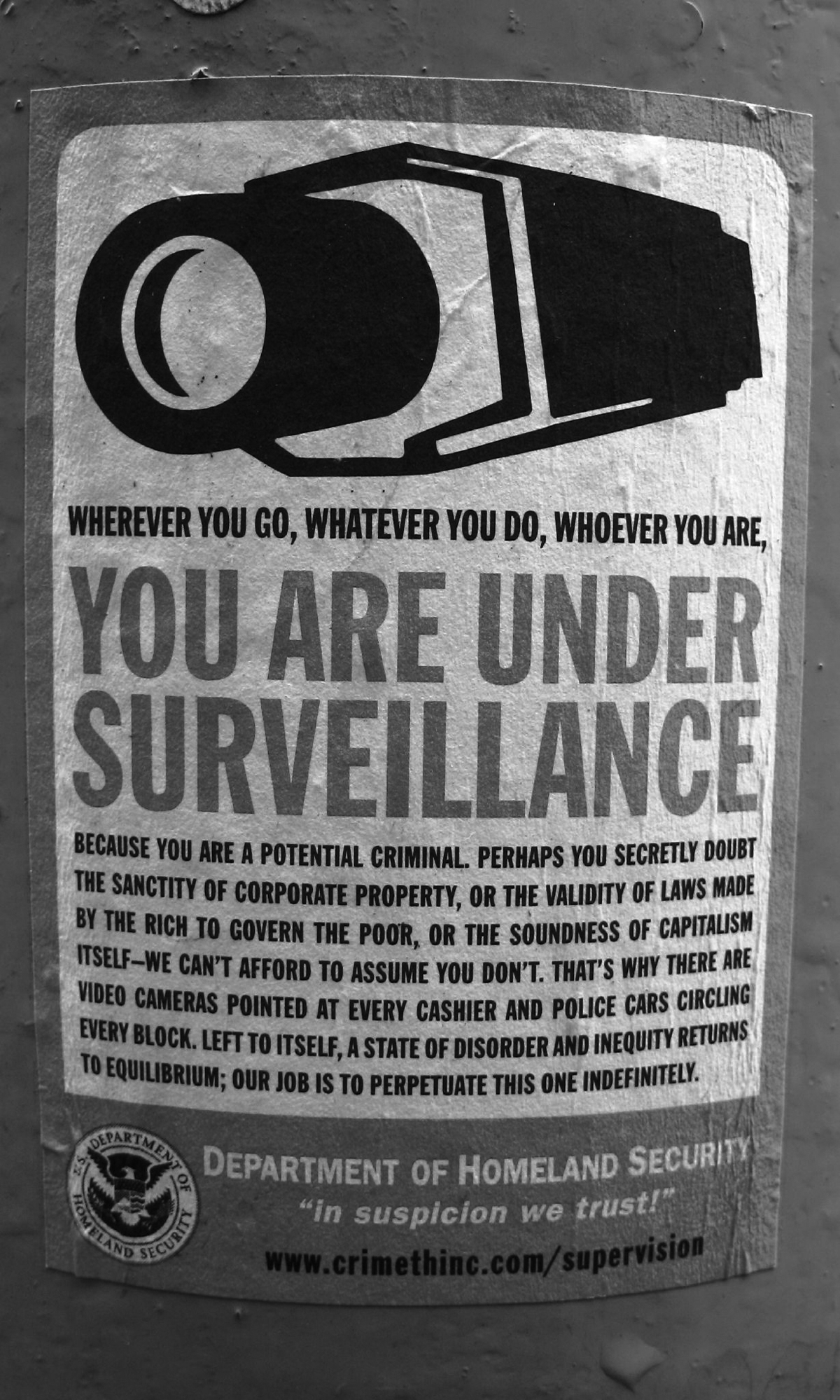

Imagen / Afiche del colectivo CrimeThinc, 2006. Fuente

El debate sobre leyes y privacidad estaba inusualmente intenso en la Comisión Federal de Comercio de EE.UU. ese día. Los ejecutivos de la industria tecnológica “argumentaron que eran capaces de regularse a sí mismos y que la intervención del gobierno sería costosa y contraproducente”. Los defensores de los derechos civiles advirtieron que la capacidades de procesar datos de las compañías representaban “una amenaza sin precedentes para la libertad individual”. Uno observó: “Tenemos que decidir qué son los seres humanos en la era electrónica. ¿Solo vamos a ser mercancía para el comercio? ”Un comisionado preguntó: “¿Dónde debemos trazar la línea?” El año era 1997.

La línea nunca fue trazada, y los ejecutivos se salieron con la suya. Veintitrés años después, la evidencia es clara. El fruto de esa victoria fue una nueva lógica económica que llamo “capitalismo de la vigilancia”. Su éxito depende de operaciones que funcionan como un espejo de un sólo lado, diseñadas para nuestra ignorancia y envueltas en una niebla de engaños y eufemismos. Se arraigó y floreció en los nuevos espacios de Internet, una vez celebrados por los capitalistas de la vigilancia como “el espacio sin gobierno más grande del mundo“. Pero el poder llena los espacios vacíos, y estos lugares ya no están desgobernados. En cambio, son propiedad de los capitalistas de la vigilancia, y se rigen por sus leyes de hierro.

El auge del capitalismo de la vigilancia en las últimas dos décadas fue prácticamente incontrarrestable. “Digital=rápido”, nos dijeron, y los rezagados se quedarían atrás. No es sorprendente que tantos de nosotros nos hayamos apresurado en seguir al bullicioso Conejo Blanco por su túnel hacia un País de las Maravillas digital donde, como Alicia, fuimos víctimas de la ilusión. En el País de las Maravillas, celebramos los nuevos servicios digitales como gratuitos, pero ahora vemos que los capitalistas de las vigilancia detrás de esos servicios nos consideran a nosotros como el producto gratuito. Pensamos que buscamos en Google, pero ahora entendemos que es Google el que nos busca a nosotros. Asumimos que usamos las redes sociales para conectarnos, pero nos dimos que la conexión es cómo las redes sociales nos usan a nosotros. Nos preguntamos escasamente por qué nuestro nuevo televisor o colchón tenían una política de privacidad, pero hemos comenzado a comprender que las políticas de “privacidad” son en realidad políticas de vigilancia.

Y al igual que nuestros predecesores que llamaron al automóvil “carruaje sin caballos” porque no podían reconocer su verdadera dimensión, consideramos las plataformas de Internet como “pizarras de corcho” donde cualquiera podía fijar una nota con un chinche. El Congreso estadounidense consolidó este engaño en la Sección 230 de la Ley de Decencia de Comunicaciones de 1996, eximiendo a esas compañías de las obligaciones exigidas a los “editores” e incluso a los “oradores”.

Solo repetidas crisis nos han enseñado que estas plataformas no eran pizarras de corcho, sino corrientes sanguíneas globales y de alta velocidad, en las que cualquiera puede introducir un virus peligroso sin que haya vacuna. Así es como Mark Zuckerberg, director ejecutivo de Facebook, pudo negarse legalmente a eliminar un video falso de la presidenta de la Cámara de Representantes, Nancy Pelosi, para luego duplicar su apuesta, anunciando que la publicidad política no estaría sujeta a fact checking.

Todos nuestros delirios descansan en la alucinación más traicionera de todas: la creencia de que la privacidad es privada. Hemos imaginado que podemos elegir nuestro grado de privacidad con un cálculo individual en el que se intercambia un poco de información personal a cambio de servicios valiosos, “una cosa por otra”. Por ejemplo, cuando Delta Air Lines puso a prueba un sistema de datos biométricos en el aeropuerto de Atlanta, la compañía informó que de casi 25.000 clientes que viajaban allí cada semana, un 98% optó por someterse al proceso, señalando que “la opción de reconocimiento facial está ahorrando un promedio de dos segundos por cliente al abordar, o nueve minutos en total al abordar un avión grande”.

De hecho, el rápido desarrollo de los sistemas de reconocimiento facial ilustra las consecuencias públicas de esta opción supuestamente privada. Los capitalistas de la vigilancia han exigido el derecho de registrar nuestras caras donde sea que aparezcan, ya sea en una calle de la ciudad o en una página de Facebook. El periódico The Financial Times informó que una base de datos de Microsoft, compuesta por 10 millones de imágenes extraídas de Internet sin el conocimiento de nadie, y supuestamente limitada a la investigación académica para el entrenamiento de algoritmos de reconocimiento facial, fue empleada por empresas como IBM y por agencias estatales que incluían a las fuerzas armadas estadounidenses y chinas. Entre estos, se encontraban dos proveedores chinos de equipos para funcionarios en Xinjiang, donde miembros de la comunidad Uigur viven en prisiones al aire libre bajo vigilancia perpetua mediante sistemas de reconocimiento facial.

La privacidad no es privada, pues la efectividad de estos y otros sistemas de vigilancia y control, ya sean públicos o privados, depende de aquellas partes de nosotros mismos que cedemos o que nos son robadas en secreto.

Nuestro siglo digital pudo haber sido la Edad de Oro de la democracia. En cambio, entramos en su tercera década marcada por una nueva y rígida forma de desigualdad social, la “desigualdad epistémica”. Esta época se asemeja a una era pre-Gutenberg, en la que hay asimetrías extremas de conocimiento y del poder acumulado gracias a tal conocimiento, a medida que los gigantes tecnológicos se van apoderando del control de la información y hasta del aprendizaje. El engaño de que “la privacidad es privada” fue creado para engendrar y alimentar esta división social no anticipada. Los capitalistas de la vigilancia explotan la creciente desigualdad del conocimiento para lucrar más. Manipulan la economía, nuestra sociedad e incluso nuestras vidas con impunidad, poniendo en peligro no solo la privacidad individual, sino también la democracia misma. Distraídos por nuestros delirios, no notamos este verdadero Golpe desde arriba que no ha requerido sangre para llevarse a cabo.

La creencia de que la privacidad es privada nos ha dejado a la deriva hacia un futuro que no elegimos, porque no logra reconocer la profunda diferencia entre una sociedad que dice defender derechos individuales soberanos, y otra que vive de las relaciones sociales inducidas por este espejo unidireccional. La lección que necesitamos aprender es que la privacidad es pública: es un bien colectivo, inseparable lógica y moralmente de los valores de autonomía y autodeterminación necesarios para que la privacidad exista siquiera, y sin los cuales una sociedad democrática es inimaginable.

Aún así, los vientos parecen estar cambiando por fin. Emerge una frágil nueva conciencia mientras nos abrimos camino de regreso por la madriguera del conejo hacia casa. Los capitalistas de la vigilancia son rápidos porque no buscan el consentimiento genuino ni el consenso. Confían en el adormecimiento psíquico y en el discurso de la inevitabilidad para conjurar la impotencia, la resignación y la confusión que paralizan a sus presas. La democracia es lenta, y eso es algo bueno. Su ritmo refleja las decenas de millones de conversaciones que tienen lugar en las sobremesas familiares, entre vecinos, compañeros de trabajo y amigos, al interior de comunidades, ciudades y estados, que van haciendo que el gigante dormido de la democracia entre en acción.

Estas conversaciones están ocurriendo ahora, y hay muchos indicios de que los legisladores están listos para unirse y conducir. Es probable que esta tercera década decida nuestro destino. ¿Mejoraremos nosotros el futuro digital, o será éste quien nos empeorará? ¿Será un lugar al que podamos llamar hogar?

La desigualdad epistémica no se basa en lo que podemos ganar sino en lo que podemos aprender. Se define como el acceso desigual al aprendizaje, una desigualdad impuesta por mecanismos comerciales privados de captura de información, de producción, de análisis y de ventas. Su mejor ejemplo se encuentra en el creciente abismo entre lo que nosotros sabemos y lo que se sabe sobre nosotros.

La sociedad industrial del siglo XX se organizó en torno a la “división del trabajo”: la lucha por la igualdad económica dio forma a la política de la época. Nuestro siglo digital cambia las coordenadas de la sociedad, de una división del trabajo a una “división del aprendizaje”: la lucha por el acceso al conocimiento y el poder conferido por dicho conocimiento darán forma a la política de nuestro tiempo.

La nueva centralidad de la desigualdad epistémica señala un desplazamiento del poder, desde la propiedad de los medios de producción, que definió la política del siglo XX, hacia la propiedad de la producción de significado. Los desafíos de la justicia epistémica y de los derechos epistémicos en esta nueva era se resumen en tres preguntas esenciales sobre el conocimiento, la autoridad, y el poder: ¿Quién sabe? ¿Quién decide quién sabe? ¿Quién decide quién decide quién sabe?

Durante las últimas dos décadas, los principales capitalistas de la vigilancia -Google, seguido luego por Facebook, Amazon y Microsoft-, ayudaron a impulsar esta transformación social al tiempo que garantizaban su ascenso al pináculo de la jerarquía epistémica. Operaron en las sombras para acumular enormes monopolios de conocimiento al tomar sin preguntar, una maniobra que cualquier niño reconoce como robo. El capitalismo de la vigilancia se inicia al reclamar unilateralmente la experiencia humana privada como materia prima gratuita para la traducción a datos sobre comportamiento. Nuestras vidas representadas como flujos de datos.

Desde un comienzo se descubrió que incluso los datos obtenidos libremente -y sin consentimiento de los usuarios- proporcionan ricas señales predictivas, excediendo lo que se requiere para simplemente mejorar el servicio. No es solamente lo que publicas en línea, sino también si usas signos de exclamación o la saturación de color de tus fotos; no solamente por donde caminas, sino también la inclinación de tus hombros; no solamente la identidad de tu rostro, sino también los estados emocionales transmitidos por tus “microexpresiones”; no solamente lo que te gusta, sino también el patrón que siguen tus “me gusta”. Pronto este excedente de comportamiento fue cazado y capturado en secreto, reclamado como datos de propiedad.

Los datos se transmiten a través de complejas cadenas de suministro, que involucran dispositivos y software de seguimiento y monitoreo, y ecosistemas compuestos por aplicaciones y empresas especializadas en flujos de datos de nicho capturados en secreto. Por ejemplo, pruebas realizadas por The Wall Street Journal mostraron que Facebook recibe datos de frecuencia cardíaca de Instant Heart Rate: HR Monitor, datos del ciclo menstrual de Flo Period & Ovulation Tracker, y datos que revelan interés en propiedades inmobiliarias de Realtor.com: todo ello sin el conocimiento del usuario.

Estos flujos de datos desembocan en las fábricas computacionales de los capitalistas de la vigilancia, conocidas como “inteligencia artificial”, donde se manufacturan para convertirse en predicciones sobre comportamiento que se refieren a nosotros, pero no son para nosotros. En cambio, se venden a clientes comerciales, en un nuevo tipo de mercado que negocia exclusivamente con estas predicciones. La certeza en los asuntos humanos es el elemento vital de estos mercados, donde los capitalistas de la vigilancia compiten por la calidad de sus predicciones. Esta es una nueva forma de comercio que dio origen a algunas de las compañías más ricas y poderosas de la historia.

Para lograr sus objetivos, los principales capitalistas de la vigilancia establecieron un dominio incontrarrestable sobre el 99,9% de la información mundial, que ahora se encuentra en formatos digitales que ellos mismos ayudaron a crear. El capital de la vigilancia ha construido la mayoría de las principales redes informáticas, centros de datos, poblaciones de servidores, cables de transmisión submarinos, microchips avanzados y la más avanzada inteligencia artificial, provocando una verdadera carrera armamentista por los aproximadamente 10.000 científicos que existen en el planeta capaces de extraer conocimiento desde estos vastos nuevos continentes de datos.

Con Google a la cabeza, los principales capitalistas de la vigilancia buscan controlar los mercados laborales de aquéllos que tienen experiencia en áreas críticas, incluyendo el data science y la investigación animal, superando a todos sus competidores: start-ups, universidades, escuelas secundarias, municipios, corporaciones establecidas en otras industrias y países menos ricos. En 2016, el 57% de quienes se graduaron de algún programa de Doctorado relacionado a Ciencias de la Computación en EE.UU. se fueron a trabajar a la industria, mientras que solo el 11% obtuvo algún puesto de largo plazo en una Facultad. El problema no se reduce a EE.UU: en Gran Bretaña, los administradores universitarios se lamentan porque “falta una generación” de científicos de datos; y en Canadá, un científico se queja: “el poder, la experiencia, los datos, están todos concentrados en manos de unas pocas empresas”.

Google inventó los primeros mercados -demencialmente lucrativos- que permiten comerciar con predicciones sobre el comportamiento humano: lo que hoy conocemos como publicidad dirigida en línea, en función de sus pronósticos sobre qué anuncios harían clic los usuarios. Entre el año 2000, cuando la nueva lógica económica recién estaba surgiendo, y el año 2004, cuando la compañía se hizo pública, los ingresos aumentaron en un 3.590%. Esta desconcertante cifra representa el “dividendo de la vigilancia”. Los inversores recuperaron su dinero rápidamente, y tanto las start-ups, como los desarrolladores de apps y hasta las compañías establecidas tornaron sus modelos de negocio hacia el capitalismo de la vigilancia. La promesa de un atajo hacia ingresos descomunales por la venta de predicciones impulsó esta migración primero a Facebook, luego a través del sector tecnológico en general, y ahora en todo el resto de la economía, incluyendo industrias tan dispares como aseguradoras, comercios minoristas, finanzas, educación, atención médica, inmobiliarias, entretenimiento, y cualquier producto adjetivado con la palabra “inteligente” o cualquier servicio promocionado como “personalizado”.

Incluso Ford, cuna de la economía basada en la producción en masa del siglo XX, está tras el rastro del dividendo de la vigilancia. Ante la reducción de las ventas de automóviles, se han propuesto reinventar sus vehículos como un “sistema operativo de transporte”. En palabras de un analista, Ford “podría hacer una fortuna monetizando datos; no necesitarán ingenieros, fábricas o distribuidores para hacerlo. Es casi pura ganancia”.

Los imperativos económicos del capitalismo de la vigilancia se han ido refinando al ritmo de la competencia por quién vende mayor certeza. Al principio, estaba claro que la inteligencia artificial necesitaba alimentarse de grandes volúmenes de datos, lo que obligaba a buscar economías de escala en la extracción de datos. Luego se entendió que el volumen es necesario pero no suficiente. Los mejores algoritmos también requieren variedades de datos: economías de alcance. Comprender esto ayudó a impulsar la “revolución móvil”, enviando a los usuarios al mundo real armados con cámaras, computadoras, giroscopios y micrófonos empaquetados dentro de sus nuevos smartphones. Al competir por esta diversidad en los datos, los capitalistas de la vigilancia quieren acceso tu hogar y lo que dices y haces al interior de sus paredes. Quieren saber sobre tu automóvil, tus afecciones médicas y los programas que ves; tu ubicación, así como todas las calles y edificios que se encuentran en tu camino, y todo el comportamiento de todas las personas en su ciudad. Quieren tu voz y lo que comes y lo que compras; los juegos y la escuela de tus hijos; tus ondas cerebrales y tu torrente sanguíneo. Nada se salva.

El conocimiento desigual sobre nosotros produce un poder desigual sobre nosotros, con lo que la desigualdad epistémica se amplía, incluyendo la distancia entre lo que nosotros podemos hacer y lo que se nos puede hacer a nosotros. Los científicos de datos describen esto como el paso desde el monitoreo a la acción, cuando una masa crítica de conocimiento sobre un sistema permite controlar remotamente a este sistema. El objetivo para este control remoto ahora son las personas, pues los capitalistas de la vigilancia descubrieron que los datos más predictivos se obtienen al intervenir el comportamiento para uniformarlo, modificarlo y alinearlo con los objetivos comerciales. Este tercer imperativo, “economías de acción“, se ha convertido en un escenario de intensa experimentación. “Estamos aprendiendo a escribir la música”, dijo un científico, “para luego dejar que la música los haga bailar”.

Este nuevo poder “para hacerlos bailar” no emplea soldados para amenazar mediante el terror y el asesinato. Llega con un capuchino, no con una pistola. Es un nuevo poder “instrumental”, que trabaja su voluntad a través de instrumentos digitales omnipresentes, que permiten manipular señales subliminales, dirigir las comunicaciones psicológicamente, imponer arquitecturas de elección por defecto, desencadenar dinámicas de comparación social y proveer recompensas y castigos: todo dirigido a la sintonización remota, pastoreando y modificando el comportamiento humano hacia resultados rentables. Todo siempre diseñado para preservar la ignorancia de los usuarios.

Un ejemplo concreto de capacidad predictiva transformándose en “poder instrumental” se hizo visible con los experimentos de contagio de Facebook, publicados en 2012 y 2014, cuando señales subliminales fueron sembradas y comparaciones sociales fueron manipuladas en sus páginas, primero con el objetivo de que los usuarios votaran en las elecciones de 2014, y luego para que las personas se sintieran más tristes o más felices. Los investigadores de Facebook celebraron el éxito de estos experimentos señalando dos hallazgos clave: es posible manipular las señales online para influir en los comportamientos y sentimientos del mundo real, y que esto podría lograrse pasando por alto la conciencia de los usuarios.

En 2016 Pokémon Go, el juego de realidad aumentada desarrollado por Google, probó las economías de acción en las calles. Los jugadores del juego no se sabían peones en el juego real de modificación del comportamiento con fines de lucro, ya que las recompensas y castigos por cazar criaturas imaginarias eran usados para llevar a los usuarios a McDonald’s, Starbucks y locales de pizza, que pagaban a la compañía por cada visita (pago por “pisada”), exactamente de la misma manera que los anunciantes online pagan por cada click en sus sitios web.

En 2017, un documento de Facebook se filtró y fue adquirido por The Australian. Este documento expuso el interés de la corporación en aplicar “aprendizajes psicológicos” obtenidos a partir de “datos internos de Facebook” para modificar el comportamiento de los usuarios. El objetivo eran 6,4 millones de jóvenes australianos y neozelandeses. “Al monitorear publicaciones, imágenes, interacciones y actividad en Internet en tiempo real”, escribieron los ejecutivos, “Facebook puede determinar cuando los jóvenes se sienten ‘estresados’, ‘derrotados’, ‘abrumados’, ‘ansiosos’, ‘nerviosos’, ‘estúpidos’, ‘tontos’, ‘inútiles’ y ‘fracasados’”. La profundidad de esta información, explicaron, le permite a Facebook determinar el lapso de tiempo durante el cual un joven necesita un “impulso de confianza”, y está más expuesto frente a configuraciones específicas de señales y gatillantes subliminales. Los datos se utilizan para hacer coincidir cada fase emocional con mensajes publicitarios apropiados, de modo de maximizar la probabilidad de ventas garantizadas.

Facebook negó estas prácticas, aunque un ex gerente de producto acusó a la compañía de “mentir descaradamente”. El hecho es que en ausencia de transparencia corporativa y control democrático, la desigualdad epistémica es la que manda. Ellos saben. Ellos deciden quién sabe. Ellos deciden quién decide.

El conocimiento público se encuentra en una desventaja inaceptable. Esto se profundiza con el perfecto uso de la comunicación de masas que llevan a cabo los capitalistas de la vigilancia, al utilizarla como herramienta para manipular. Dos ejemplos son ilustrativos. El 30 de abril de 2019, Mark Zuckerberg hizo un anuncio dramático en la conferencia anual de desarrolladores de la compañía, declarando: “El futuro es privado”. Unas semanas más tarde, un abogado de Facebook apareció ante un juez de distrito federal en California para frustrar una demanda de usuarios por invasión de privacidad, argumentando que el mero hecho de usar Facebook niega cualquier expectativa razonable de privacidad “como una cuestión legal”. En mayo de 2019, Sundar Pichai, director ejecutivo de Google, escribió en The Times sobre el compromiso de sus corporaciones con el principio de que “la privacidad no puede ser un bien de lujo”. Cinco meses después, trabajadores de Google fueron descubiertos ofreciendo tarjetas de regalo de 5 USD$ a cambio de una exploración facial a indigentes afroamericanos en un parque de Atlanta.

La negación por parte de Facebook invita a un escrutinio más profundo a la luz de otro documento de la compañía, filtrado en 2018. El informe confidencial ofrece una visión inusual al corazón de la fábrica computacional de Facebook, en el que se ejecuta un “motor de predicción” sobre una plataforma de inteligencia artificial que “ingiere billones de puntos de datos cada día, entrena miles de modelos” y luego” los despliega en la flota de servidores para proveer predicciones en vivo”. Facebook señala que su “servicio de predicción” produce “más de 6 millones de predicciones por segundo”. ¿Pero con qué objetivo?

En su informe, la compañía deja en claro que estas capacidades extraordinarias están dedicadas a satisfacer los “desafíos comerciales centrales” de sus clientes corporativos, mediante procedimientos que vinculan la predicción con el marketing dirigido (microtargeting), y con la intervención y modificación del comportamiento. Por ejemplo, un servicio de Facebook llamado “predicción de lealtad” es promocionado por su capacidad de analizar el “excedente de comportamiento”, para predecir quiénes están “en riesgo” de cambiar su lealtad a una marca, y así alertar a los anunciantes para que intervengan rápidamente con mensajes específicos, diseñados para estabilizar la lealtad: justo a tiempo para alterar el curso del futuro.

Ese año, un joven llamado Christopher Wylie denunció a su antiguo empleador, una consultora política conocida como Cambridge Analytica. “Explotamos Facebook para cosechar los perfiles de millones de personas”, admitió Wylie, “y construimos modelos para explotar lo que sabíamos sobre ellos y aprovecharnos de sus demonios internos”. Wylie caracterizó esas técnicas como “guerra de información”, evaluando correctamente que estas guerras en las sombras se basan en las asimetrías de conocimiento y del poder que éste ofrece. Menos claro para el público o los legisladores fue que las estrategias de invasión secreta y conquista se basaron en procedimientos usuales del capitalismo de la vigilancia, a los que miles de millones de “usuarios” inocentes son sometidos rutinariamente a diario. Wylie describió este proceso de espejo unidireccional, pero el camino que siguieron ya estaba trazado y demarcado. La única y verdadera innovación de Cambridge Analytica fue utilizar todos estos métodos para objetivos políticos en lugar de comerciales.

En otras palabras, Cambridge Analytica era un parásito viviendo de su anfitrión, el capitalismo de la vigilancia. Gracias a su dominio epistémico, el capitalismo de vigilancia proporcionó los datos de comportamiento que expusieron a quienes iban a ser asaltados. Sus métodos de microtargeting conductual y modificación del comportamiento se convirtieron en las armas. Y fue la facilidad que tiene el capitalismo de la vigilancia para no rendir cuentas por el contenido de sus plataformas (gracias a la mencionada Sección 230) lo que brindó la oportunidad para los ataques furtivos, diseñados para desencadenar los demonios internos de ciudadanos desprevenidos.

No es sólo que la desigualdad epistémica nos deja completamente vulnerables a los ataques de actores como Cambridge Analytica. El punto más grande y más inquietante es que el capitalismo de la vigilancia ha convertido la desigualdad epistémica en una condición definitoria de nuestras sociedades, normalizando la guerra por la información como una característica crónica de nuestra realidad diaria, un guerra sostenida por las mismas corporaciones de las que dependemos para una participación social efectiva. Tienen el conocimiento, las máquinas, la ciencia y los científicos, los secretos y las mentiras. Toda nuestra privacidad ahora recae en ellos, dejándonos con pocos medios de defensa frente a los merodeadores que invaden nuestros datos. Sin ley, luchamos por escondernos en nuestras propias vidas, mientras nuestros hijos debaten estrategias de cifrado de la información en la sobremesa, y los estudiantes se cubren con máscaras cuando protestan, como protección contra los sistemas de reconocimiento facial construidos con nuestras fotos familiares.

Ante la ausencia de nuevas legislaciones y de declaraciones sobre los derechos epistémicos, el capitalismo de la vigilancia amenaza con rehacer la sociedad a medida que deshace la democracia. Desde abajo, socava la agencia humana, usurpando la privacidad, disminuyendo la autonomía y privando a los individuos del derecho a combatir. Desde arriba, desigualdad epistémica e injusticia son incompatibles en esencia con las aspiraciones de un pueblo democrático.

Sabemos que los capitalistas de la vigilancia trabajan en las sombras, pero qué es lo que hacen allí y cuál es el conocimiento que acumulan nos es desconocido. Tienen los medios para ellos saber todo sobre nosotros, pero nosotros podemos saber poco sobre ellos. Su conocimiento acerca de nosotros no es para nosotros. En cambio, nuestros futuros se venden para las ganancias de otros. Desde esa reunión de la Comisión Federal de Comercio en 1997, la línea nunca se trazó, y las personas sí se convirtieron en bienes transables para el comercio. Otro ilusión destructiva es que este resultado fue inevitable, un costo insalvable a cambio de mejorar nuestra comodidad con las tecnologías digitales. La verdad es que el capitalismo de la vigilancia secuestró el medio digital. No había nada inevitable al respecto.

Los legisladores estadounidenses han sido reacios a asumir estos desafíos por muchas razones. Una de ellas es una política no escrita de “hacer excepciones respecto a la vigilancia”, forjada después de los ataques terroristas del 11 de septiembre, cuando las preocupaciones del gobierno pasaron de proteger la privacidad online, a un entusiasmo renovado por la “total information awareness1“. En ese ambiente político, las incipientes capacidades para vigilar que emergían desde Silicon Valley parecían muy prometedores.

Los capitalistas de la vigilancia también se han defendido con lobby y formas de propaganda destinadas a socavar e intimidar a los legisladores, confundir el juicio y congelar la acción. Estos han recibido relativamente poco escrutinio en comparación con el daño que hacen. Consideremos dos ejemplos:

La primera es la afirmación de que la democracia amenaza la prosperidad y la innovación. El ex presidente ejecutivo de Google, Eric Schmidt, explicaba en 2011: “tomamos la posición de ‘dejen sus manos fuera de Internet’. Ya sabes, déjanos en paz … El gobierno puede cometer errores regulatorios que pueden retrasar todo esto, y nosotros vemos esto y nos preocupamos”. Esta propaganda se recicla de los barones de la Edad del Oro de EE.UU., a quienes hoy denominados “bandidos”. Ellos insistían en que no se necesitaban leyes cuando se tenía la “ley de supervivencia del más apto”, las “leyes del capital”, y la”ley de la oferta y la demanda”.

Paradójicamente, el capital de la vigilancia no parece impulsar la innovación. Una prometedora nueva era de investigación económica muestra el papel fundamental que el gobierno y la gobernanza democrática han desempeñado en la innovación, y sugiere una falta de innovación en grandes empresas tecnológicas como Google. La información dominada por el capitalismo de la vigilancia no está dedicada a los desafíos urgentes de la humanidad como la energía libre de carbono, la eliminación del hambre, la cura del cáncer, librar los océanos de plástico o inundar el mundo con profesores y médicos bien pagados, inteligentes y amorosos. En cambio, vemos una operación en la frontera del conocimiento, dirigida por genios con gran capital y poder computacional, que se dedica furiosamente a la lucrativa ciencia y economía de la predicción humana con fines de lucro.

La segunda forma de propaganda es el argumento de que el éxito de las principales firmas capitalistas de la vigilancia refleja el valor real que aportan a las personas. Pero los datos del lado de la demanda sugieren que el capitalismo de la vigilancia puede ser mejor descrito como una falla de mercado. En lugar de una alineación estrecha entre la oferta y la demanda, las personas usan estos servicios porque no tienen alternativas comparables y porque ignoran las operaciones ocultas del capitalismo de la vigilancia y sus consecuencias. El Centro de Investigación Pew informó recientemente que el 81% de los estadounidenses cree que los riesgos potenciales de la recopilación de datos por parte de estas empresas superan los beneficios, lo que sugiere que su éxito corporativo depende de la coerción y la ofuscación antes que de satisfacer las necesidades reales de las personas.

En su premiada historia de la regulación, el historiador Thomas McCraw hace una advertencia. A lo largo de los siglos, los reguladores fallaron cuando no formularon “estrategias apropiadas para las industrias específicas que les tocaba regular”. Las actuales leyes de privacidad y antimonopolio son vitales, pero no serán totalmente adecuadas para los nuevos desafíos de revertir la desigualdad epistémica.

Estos desafíos del siglo XXI exigen un marco de derechos epistémicos consagrados en la ley y sujetos a la gobernanza democrática. Tales derechos interrumpirían las cadenas de suministro de datos al salvaguardar los límites de la experiencia humana antes de que sean atacados por las fuerzas de la dataficación. En una sociedad democrática, la elección de convertir cualquier aspecto de la propia vida en datos debe pertenecer a las personas en virtud de sus derechos. Esto significa, por ejemplo, que las compañías no pueden reclamar un derecho sobre tu cara, o sobre usar tu cara como materia prima gratuita para hacer análisis, o sobre poseer y vender cualquier producto computacional que se derive de tu cara. La conversación sobre derechos epistémicos ya ha comenzado, reflejada en un informe pionero de Amnistía Internacional.

Desde el lado de la demanda, podemos proscribir los mercados de las predicciones humanas, y así eliminar los incentivos financieros que sostienen el dividendo de la vigilancia. Ésta no es una perspectiva radical. Por ejemplo, las sociedades prohíben los mercados que comercian con órganos humanos, bebés y esclavos. En cada caso, reconocemos que tales mercados son moralmente repugnantes y producen consecuencias previsiblemente violentas. Se puede demostrar que los mercados de las predicciones humanas producen resultados igualmente previsibles, que también desafían la libertad humana y socavan la democracia. Al igual que las hipotecas de alto riesgo y las inversiones en combustibles fósiles, los activos de vigilancia se convertirán en los nuevos activos tóxicos.

Los legisladores deberán defender nuevas formas de acción colectiva, al igual que hace casi un siglo, cuando se protegieron legalmente los derechos de organización, huelga y negociación colectiva, gracias a la unión de legisladores y trabajadores para hacer frente al poder de los capitalistas monopolistas. Los legisladores hoy deben aliarse con ciudadanos que están profundamente preocupados por el poder incontrolado de los capitalistas de la vigilancia, y con trabajadores que buscan salarios justos y condiciones de seguridad, haciendo frente a las precarias condiciones de empleo que definen la economía de vigilancia.

Cualquier cosa hecha por humanos puede ser deshecha por humanos. El capitalismo de la vigilancia es joven, tiene apenas 20 años; la democracia, en cambio, es antigua, y está arraigada en generaciones de esperanza y rebeldía.

Los capitalistas de la vigilancia son ricos y poderosos, pero no son invulnerables. Tienen un talón de Aquiles: el miedo. Temen a los legisladores que no les temen. Temen a los ciudadanos que exigen un nuevo camino a seguir, ya que insisten en nuevas respuestas a viejas preguntas: ¿Quién sabrá? ¿Quién decidirá quién sabe? ¿Quién decidirá quién decide? ¿Quién escribirá la música y quién bailará?

Notas